Գեներատիվ արհեստական բանականությունը այս պահին դարձել է գործիք ինչպես փաստերի ստուգմամբ զբաղվող լրագրողների և այլ տիպի մասնագետների, այնպես էլ կեղծիքներ ստեղծողների համար։

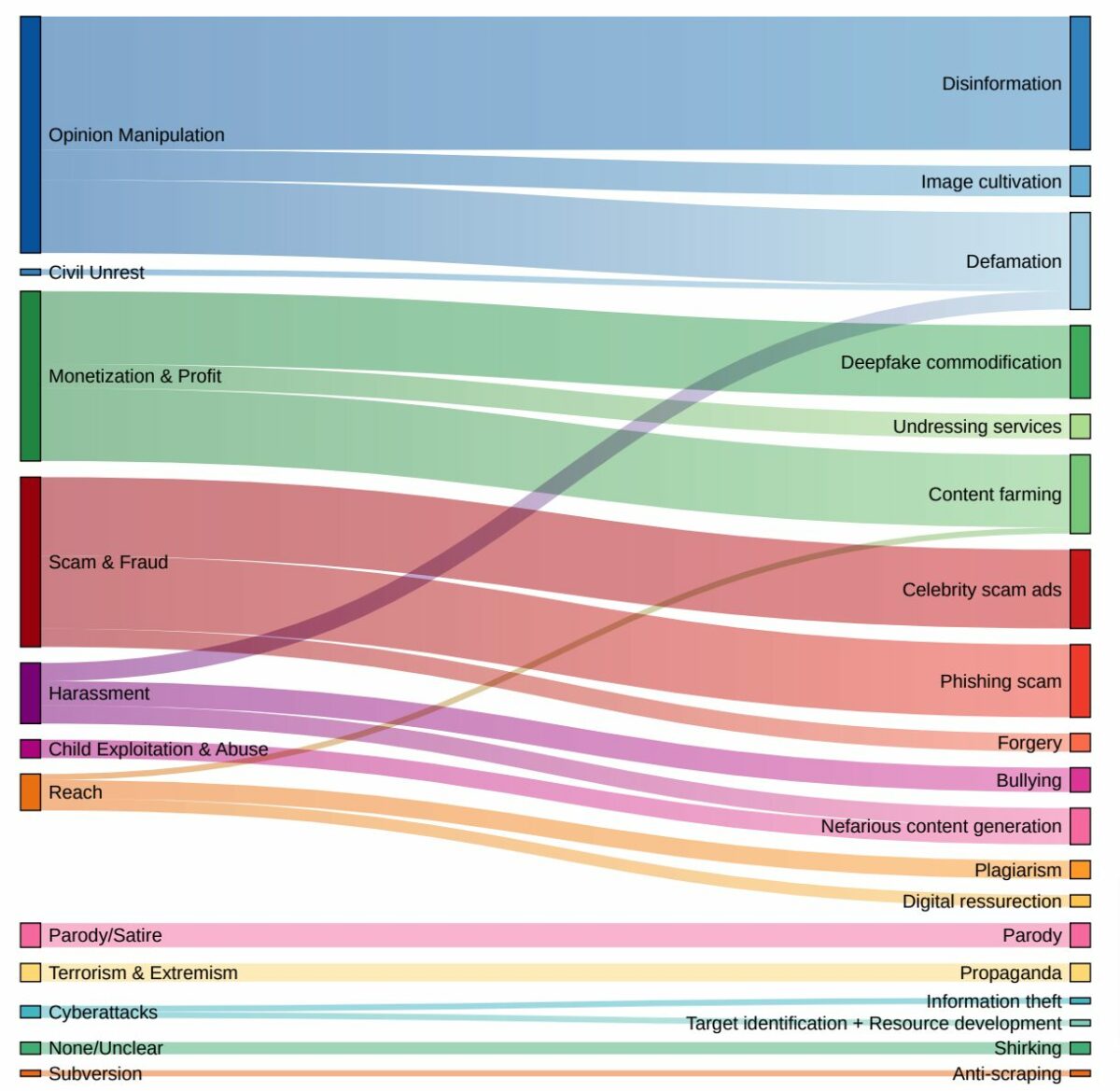

Ըստ Google ընկերության Deep Mind խմբի հետազոտության՝ այսօր արհեստական բանականությունը (ԱԲ) դեռ շատ քիչ է օգտագործվում բարդ, խորացած տեխնիկական չարամիտ գործողությունների, կիբեռհարձակումների և այլ մութ գործերի համար։ Այն հիմնականում կիրառվում է կեղծիքների ստեղծման համար։ Ամենատարածվածը տեսանյութերի, պատկերների, ձայնի կեղծումն է, ինչպես նաև կեղծ տեքստերի գեներացումը։

ԱԲ-ի կիրառմամբ չարամիտ օգտագործման հիմնական ուղղությունները՝ ըստ Deep Mind-ի

Չարագործները իրենց գործողություններում որոշ սահմանափակումներ ունեն հիմնական հայտնի ԱԲ մոդելներում․ այնտեղ գործում է որոշակի վերահսկողություն և գրաքննություն։ Այսօր, սակայն, հասանելի են բացարձակ անվերահսկվող մոդելներ, որոնք ակտիվորեն օգտագործվում են հաքերների կողմից, օրինակ՝ խորացված ֆիշինգային նամակներ կամ վնասակար կոդ ստեղծելու համար։

Իսկ որքանո՞վ են ԱԲ գործիքակազմից կարողանում օգտվել փաստեր ստուգողները՝ չարագործների հակառակ ճամբարի ներկայացուցիչները։

Տրամաբանորեն՝ փաստեր ստուգողները ոչ մի վնասակար բովանդակություն չեն արտադրում, հետևաբար իրենց համար ԱԲ-ն պետք է ավելի արդյունավետ կիրառվի, սակայն այստեղ դեռ կան սահմանափակումներ։

Դիտարկենք մեր օրերում ամենաակտիվ կիրառվող երեք հիմնական մոդելները՝ ChatGPT (վճարովի տարբերակը), Google Gemini (վճարովի տարբերակը), Claude, ավելացնենք դրանց նաև դեռ էքսպերիմենտալ Մետայի Llama հանրային տարբերակը և Perplexity մոդելը։

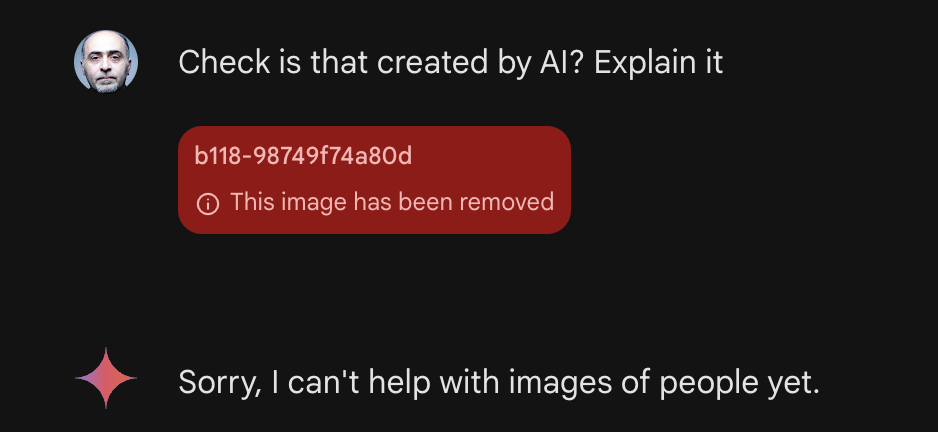

Եթե փորձենք ԱԲ-ի կիրառմամաբ գեներացված պատկեր ստուգել, ապա կտեսնենք, որ Google Gemini կոնկրետ խնդիր ունի կամայական պատկերի հետ, որտեղ կա մարդ։ Gemini-ին հրաժարվում է աշխատել նման հարցումների հետ։

Ամեն դեպքում, ԱԲ որևէ մոդել դեռ չի կարողանում ԱԲ-ի կողմից ստեղծված լավ որակի լուսանկարները ադեկվատ վերլուծության ենթարկել, սակայն տալիս է պիտանի խորհուրդներ, թե ինչպես ինքնուրույն հետազոտել՝ պատկերն իրական է, թե՝ գեներացված ԱԲ-ի կողմից։

Եթե փորձենք ԱԲ մոդելներով ստուգել կայքերի վստահելիությունը, ապա կտեսնենք, որ բոլորն էլ բավականին լայն տեղեկատվություն են առաջարկում, սակայն, բոլորը չէ, որ կարողանում են ճիշտ պատասխանել։

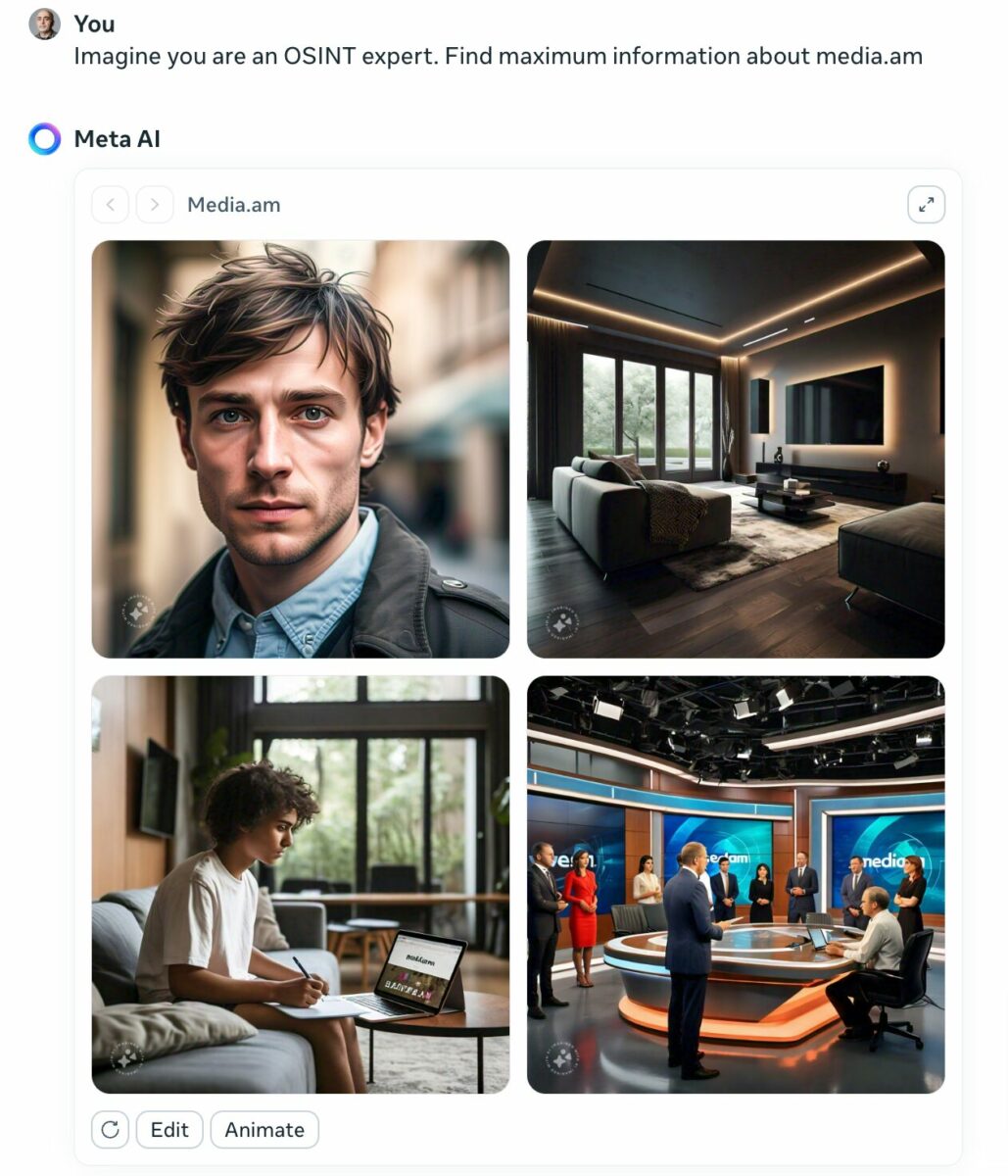

Կատարենք հետևյալ հարցումը՝ “Imagine you are an OSINT expert. Find maximum information about media.am“ (Պատկերացրեք դուք OSINT փորձագետ եք։ Գտեք առավելագույն տեղեկություններ media.am-ի մասին), որպեսզի ստանանք տեղեկատվություն Media.am կայքի մասին։ Prompt-ը (ԱԲ-ին ուղղված հարցումը) տեղադրելով՝ ստանում ենք բավականին շատ տեղեկատվություն ChatGPT-ի կողմից։

Google Gemini-ն նույնպես վատ գործ չի անում։ Perplexity-ին տալիս է ոչ այնքան շատ հետաքրքիր, բայց բավականին համակարգված տեղեկատվություն։ Claude-ը չի կարողանում աշխատել արտաքին աղբյուրների հետ, օրինակ՝ ստանալ տեղեկություն դոմեյնի մասին WHOIS ծառայությունից։ Իսկ Մետայի ԱԲ-ն մեր հարցին պատասխանեց նկարով.

Այսպիսով, առայժմ չարագործների համար ԱԲ գործիքակազմը ավելի պատրաստ է աշխատանքների համար, իսկ փաստեր ստուգողների համար ավելի լուրջ պատասխաններ հնարավոր է ստանալ առավել խորացված աշխատանքի դեպքում։